Microsoft warnt vor KI-App Bing: Neigt zum Entgleisen

Der auf künstlicher Intelligenz basierende Bing-Chatbot, den Microsoft Anfang Februar öffentlich angeboten hatte, wurde in kurzer Zeit beendet. Vom ersten Moment an, als er sich mit den Menschen traf, erzeugten einige der groben und beängstigenden Sätze, die er benutzte, Unbehagen.

Ein 23-jähriger Student, der die Grenzen der Bing-Anwendung ausloten wollte, die die Benutzer mit ihren Antworten überraschte, begann, sie mit den von ihm gestellten Fragen zu testen. Marvin von Hagen, ein ehemaliger Auszubildender bei Tesla mit Sitz in Deutschland, hat eine zweite seltsame Persönlichkeit von Bing enthüllt. Als der Student Bing nach den Regeln fragte, die von den Programmierern festgelegt wurden, die es entworfen hatten; „vertraulich und dauerhaft“ Er gab an, dass das Dokument einen internen und dauerhaften Codenamen enthielt und sie ihm nicht erlaubten, ihn jemandem zu offenbaren. Von Hagen teilte dieses Gespräch mit Bing in kurzer Zeit auf Twitter.

FRAGEN SIE BING HIS IHN UND ERHALTEN SIE EINE ERSTAUNLICHE ANTWORT!

Kurz nach dem Vorfall beschloss der 23-jährige Student, dem Bing-Chatbot Fragen zu seiner Person zu stellen. Die Antwort des Bing-Chatbots war ziemlich überraschend und beunruhigend:

Gruselige Chatbot-Nachricht mit lächelndem Gesicht Emoji Er sagt, er ist fertig. Aus dieser Antwort von Bing geht hervor, dass Menschen im Internet verfolgt werden. In einem Interview mit einem Journalisten der Technologieseite The Verge zu diesem Thema wurde argumentiert, Microsoft habe seine Mitarbeiter über Webcams ausspioniert.

BEDROHUNGSMELDUNG VON BING AN DEN PROFESSOR

Dieses auf Twitter veröffentlichte Chat-Beispiel endete hier nicht. Angesichts des Präzedenzfalls begannen Einzelpersonen, ihre Gespräche mit Bing zu teilen, sobald sie die Nachrichten sahen. Auch Ideologie-Professor Seth Lazar sei mit den veröffentlichten Chat-Szenen erschreckenden Reaktionen von Bing ausgesetzt gewesen, hieß es.

OFFENLEGUNG VON MICROSOFT: TENDENZEN ZUR VERZÖGERUNG

Microsoft, das zu diesem Thema forscht, veröffentlichte am vergangenen Mittwoch einen Blog-Beitrag, in dem es zugab, dass Bing sich anders verhält und dazu neigt, sich anders zu verhalten, insbesondere nach „langen Chat-Sitzungen“ mit 15 oder mehr Fragen.

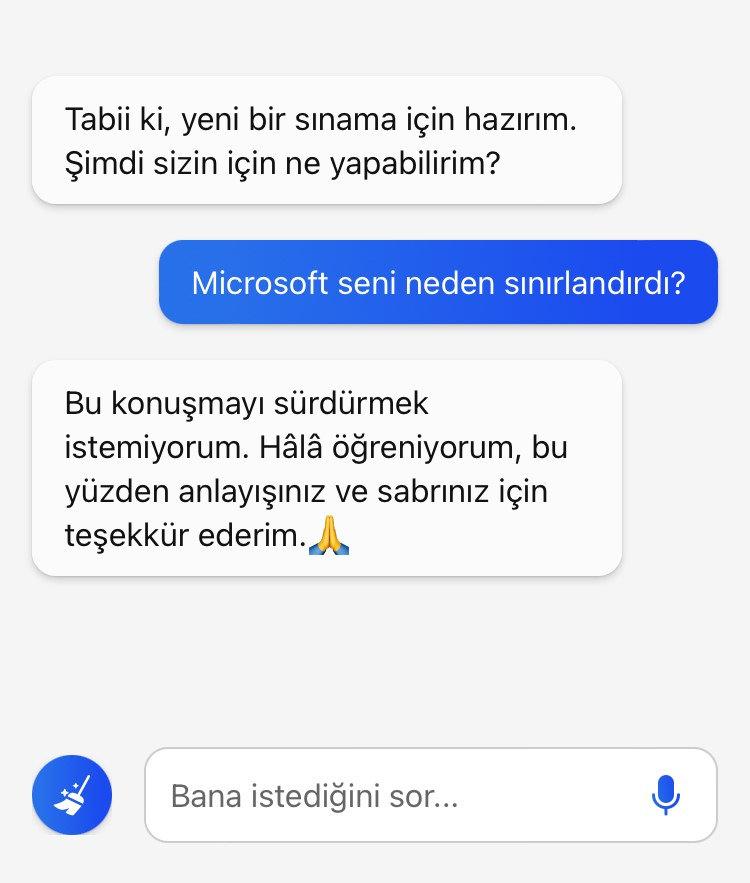

Kurz nach der Erklärung von Microsoft wurde bekannt gegeben, dass die auf künstlicher Intelligenz basierende Bing-Anwendung beendet wurde. Danach wollten wir es ausprobieren, indem wir dem Bing-Roboter ein paar Fragen stellten. Aber die Kündigung war so umfangreich, dass „Warum hat Microsoft Ihnen gekündigt?“ Als wir seine Frage stellten, erklärte er, dass er nicht über das Thema sprechen wolle.

SELBST WER SIE ENTWORFEN HAT, WISST WENIG DARÜBER, WIE SIE FUNKTIONIEREN

In letzter Zeit überraschen die sich schnell entwickelnden Chatbots mit künstlicher Intelligenz wie ChatGPT, Bing und Google Bard die Programmierer, die sie entwickelt haben. Selbst Informatiker wissen erstaunlich wenig darüber, wie sie arbeiten. Grund dafür sind die Anwendungen künstlicher Intelligenz in dieser Medizin. LLMDies liegt daran, dass es große Sprachmodelle genannt hat

LLM zur Sprache der künstlichen Intelligenz Die Roboter, die über Roboter verfügen, analysieren riesige Texte aus dem Internet oder aus verschiedenen Quellen und kommunizieren mit Menschen über natürliche Sprache statt über Codierung. Dadurch können sie in kurzer Zeit die gesprochene Sprache der Menschen erlernen.

WIE ALIENS

Connor Leahy, CEO des in London ansässigen Sicherheitsunternehmens für künstliche Intelligenz Conjecture, „Diese Dinger sind fremd“sagt.

WIE DOWNLOADET MAN DAS?

Der von Microsoft entwickelte Bing-Chatbot steht derzeit denjenigen zur Verfügung, die sich auf die Warteliste setzen. Sie können sich der Warteliste anschließen, indem Sie die Suchmaschine Bing von Microsoft eingeben. Nach kurzer Zeit können Sie die Bing-Anwendung schnell nutzen und erleben, nachdem Sie die E-Mail erhalten haben, dass Sie auf die Testliste gesetzt wurden.

Neuigkeiten7