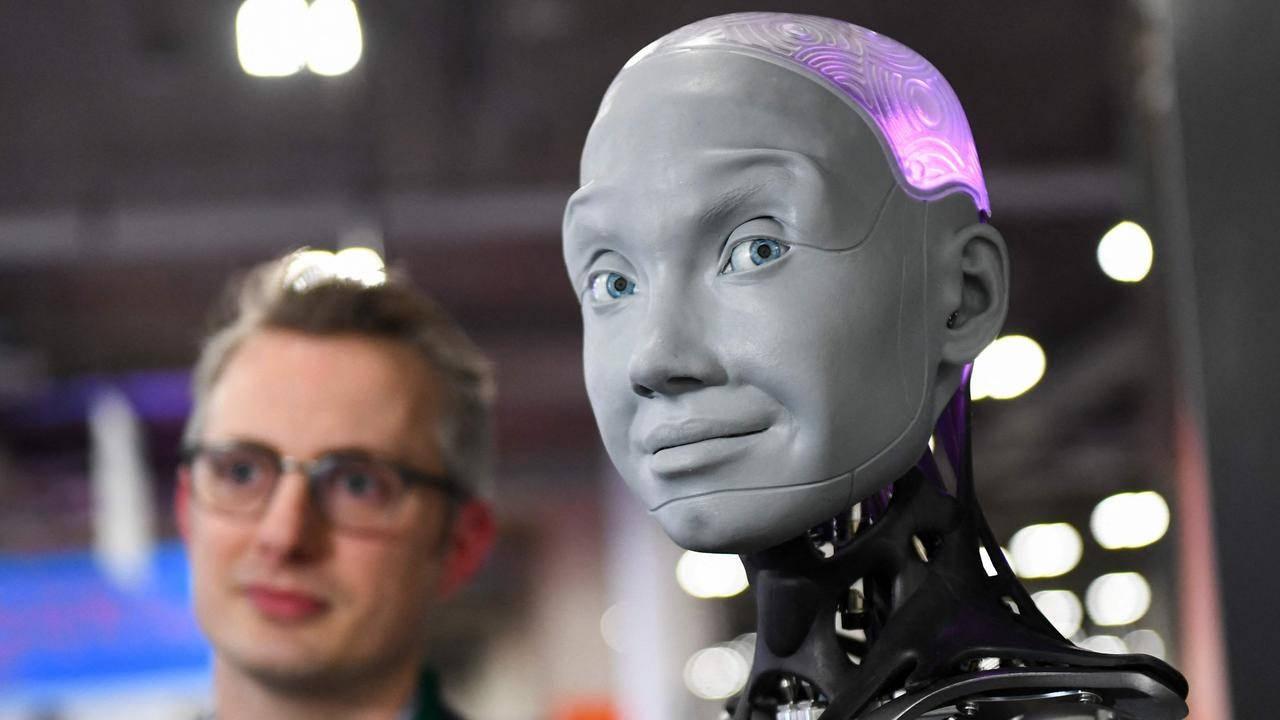

Google ist aufgestiegen: Roboter können jetzt durch Zuschauen lernen!

Am Freitag stellte Google Robotics Transformer 2 (RT2) vor, ein Vision-Language-Action (VLA)-Modell, das Texte und Bilder in Roboteraktionen umwandeln kann.

In einem Blogbeitrag von Google DeepMind Robotics Leader Vincent Vanhoucke: „So wie Sprachmodelle an Webtexten trainiert werden, um allgemeine Ideen und Konzepte zu lernen, zieht RT-2 Informationen aus Webinformationen, um das Roboterverhalten zu beeinflussen. Mit anderen Worten, RT-2 kann roboterhaft sprechen.“gab seine Worte.

Vanhocke erklärte, dass Chatbots durch die Bereitstellung von Informationen zu einem Thema trainiert werden können, Roboter jedoch in der realen Welt noch einen Schritt weiter gehen. „Erdung“sagt, dass es so sein sollte.

Als Beispiel nennt er einen roten Apfel: „Während man einem Chatbot einfach erklären kann, was ein Apfel ist, muss ein Roboter alles über den Apfel wissen und lernen, ihn von einem Beispielobjekt (zum Beispiel einem roten Ball) zu unterscheiden und ihn auszuwählen.“ hoch.“

ROBOTER KÖNNEN SIE TRAINIEREN, INDEM SIE OBJEKTE PRÜFEN

Mithilfe von Daten aus dem Internet geht der RT-2 einen Schritt weiter als der RT-1 von Google und andere Modelle. Wenn Sie beispielsweise möchten, dass ein früheres Modell etwas wegwirft, müssen Sie es darüber aufklären, was Müll ist und wie man ihn verwendet.

Beim RT-2 wurde angegeben, dass zwar nicht erklärt wird, was der Müll ist und wie er verwendet wird, dass der Roboter diesen Teil jedoch mithilfe von Webdaten selbst lösen kann.

Dank der neuen künstlichen Intelligenz wird sichergestellt, dass die gelernten Informationen in die Tat umgesetzt werden.

Mit dem RT-2 können Roboter lernen und das Gelernte auf zukünftige Situationen anwenden. Google gibt jedoch an, dass der RT-2 in seiner aktuellen Form aufgrund der Einschränkungen dazu beitragen kann, dass ein Roboter bei physischen Aufgaben, die er bereits beherrscht, präziser arbeitet und nicht nur von Grund auf lernt.

Dennoch ist es ein großer Schritt nach vorne und zeigt uns, was in Zukunft möglich ist. Für weitere Informationen geht Google in seinem DeepMind-Blog detailliert auf die Funktionsweise des RT-2 ein.

Neuigkeiten7