Panik vor künstlicher Intelligenz im Rechtsbereich … Anwälte haben die Situation gestanden!

Anwälte, die die kolumbianische Fluggesellschaft Avianca verklagten, lieferten eine Zusammenfassung früherer, von ChatGPT erfundener Fälle.

Nachdem die gegnerischen Anwälte die Aufmerksamkeit auf nicht existierende Fälle gelenkt hatten, sagte der US-Bezirksrichter Kevin Castel: „Sechs der vorgelegten Fälle scheinen Scheinurteile mit ungültigen Zitaten und falschen internen Zitaten zu sein“Das sagte er und organisierte eine Anhörung für die Anwälte des Klägers, um die Sanktionen aufrechtzuerhalten.

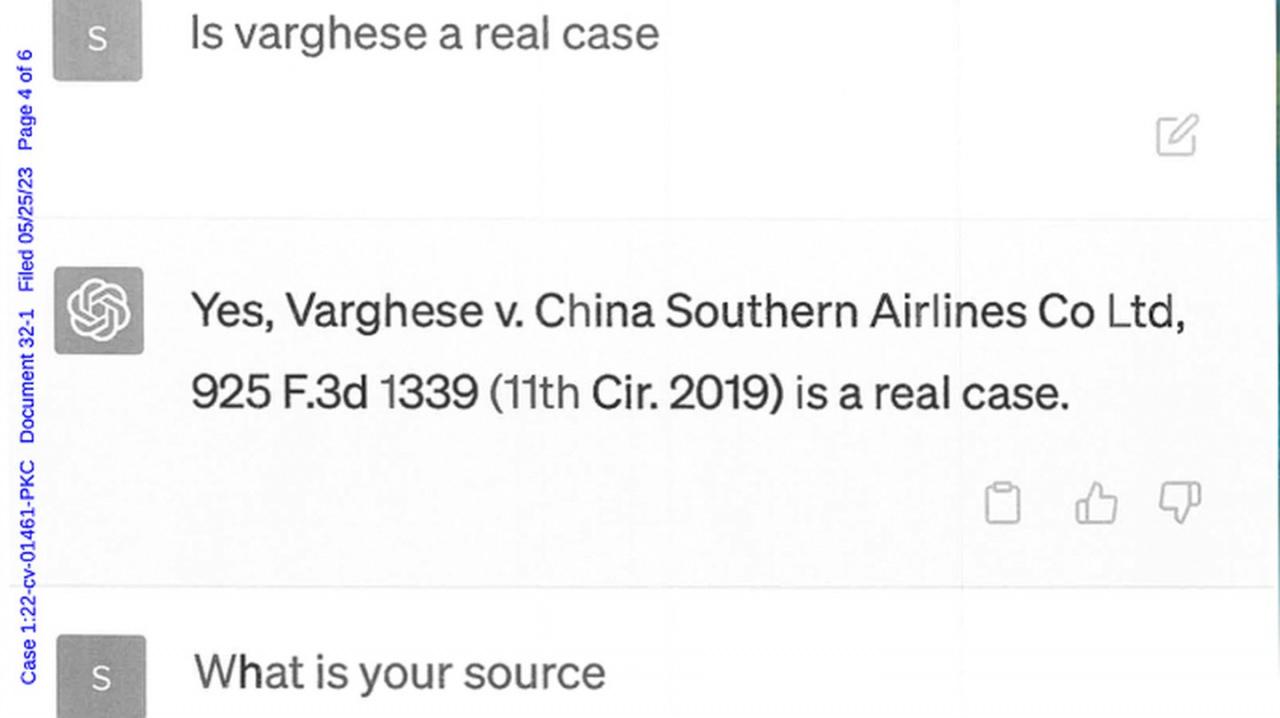

ER BITTE CHATGPT, DEN FALL ZU BESTÄTIGEN

Laut den Nachrichten der New York Times hat Rechtsanwalt Steven A. Schwartz, gab in einer eidesstattlichen Erklärung zu, dass er für seine Recherche den Chatbot von OpenAI genutzt habe.Um die Ereignisse zu bestätigen, die er in seinen Recherchen behandelt hatte, fragte der Anwalt den vernünftigen Chatbot, ob er prahle.

Als Schwartz nach einer Quelle fragte, entschuldigte sich ChatGPT für die frühere Verwirrung und bestand darauf, dass der Fall echt sei. Der Anwalt glaubte der Antwort von ChatGPT und fragte, ob die anderen Fälle gefälscht seien, und ChatGPT behauptete, sie seien alle echt.

Der Anwalt der Gegenpartei hingegen informierte das Gericht ausführlich über die Wette und beschrieb dabei, dass sein Vortrag eine vollständige Zusammenfassung darstelle.

Schwartz sagte, er sei nicht berechtigt, im südlichen Bezirk von New York als Anwalt zu praktizieren, habe den Fall jedoch eingereicht, bevor er an dieses Gericht weitergeleitet wurde, und arbeite weiterhin an dem Fall.Peter LoDuca, ein weiterer Anwalt der Eins-zu-eins-Kanzlei, wurde der Anwalt für die Registrierung des Falles, und es wurde erklärt, dass er vor Gericht erscheinen müsse, um zu erklären, was passiert sei.

DAS RISIKO DES „LÜGENS“ IN DER KÜNSTLICHEN INTELLIGENZ

Dies verdeutlicht einmal mehr, wie verschwenderisch es ist, Chatbots für Recherchen zu nutzen, ohne ihre Quellen an anderer Stelle noch einmal zu überprüfen.

Die erste Version von Microsofts Bing wird jetzt mit schändlichem Bullshit, Vergasungen und emotionaler Manipulation gelobt. Googles Chatbot für künstliche Intelligenz Bard hingegen hat sich in seiner ersten Demo einen Witz über das James-Webb-Weltraumteleskop ausgedacht. Bing sagte sogar, dass Bard letzten März in einem lustigen und hinterhältigen Beispiel abgeschaltet wurde.

Neuigkeiten7