Die implizite Front im Tech-Krieg: KI ist die neue Waffe?

Nachrichten7

In der letzten Zeit kommt fast täglich eine neue Anwendung der künstlichen Intelligenz hinzu. Die Entwicklung von Technologien für künstliche Intelligenz birgt auch Risiken. Von Malerei und Grafikdesign bis zum Komponieren; Viele Studenten verwenden jetzt Anwendungen künstlicher Intelligenz in ihren Klassen, die argumentieren, dass sie Analysen in vielen Bereichen anbieten, vom Verfassen von Gedichten bis zum Verfassen von Artikeln. Das ‚wird Faulheit verursachen‘ Andererseits wurde in letzter Zeit behauptet, dass Übeltäter auf Konversations-KI basierende ChatBots verwenden, um Betrug und andere Cyberfehler zu begehen. Am letzten Punkt der Diskussion gibt es ‚Arbeitslosigkeit und Manipulation’…

| Die Tatsache, dass Bill Gates, der sowohl während des Covid-Prozesses als auch davor in vielen Verschwörungstheorien erwähnt wurde, Anwendungen künstlicher Intelligenz zu sehr unterstützt, lässt jedoch wieder exemplarische Theorien auftauchen … |

Während die laufenden Entwicklungen im Bereich der künstlichen Intelligenz in der Welt der Technologie einen Sturm erobern, gibt es diejenigen, die sich dieser Entwicklung entschieden widersetzen. Tatsächlich haben Bill Gates und Elon Musk, einer der reichsten der Welt, einen harten Kampf in dieser Frage.

Entwicklungen im Bereich der künstlichen Intelligenz sind nicht nur auf der Agenda von Technologieunternehmen, sondern auch ihrer Staaten angekommen. Mit Sitz in China und Italien, USA Entwickelt von OpenAI Beim Sperren von ChatGPT,Kanada und Australien haben eine Untersuchung der Praxis eingeleitet.

Warum haben Sie also ein Problem mit Anwendungen künstlicher Intelligenz? Haben Sie einen zögerlichen Ansatz? Geht es nur um personenbezogene Daten für Bans?…

Italien war das erste Land, das ChatGPT, eine auf künstlicher Intelligenz basierende ChatBot-Anwendung, verboten hat. Im Zusammenhang mit dem Verbot wurden Bedenken hinsichtlich der Verwendung von Daten geäußert. Italien blockierte ChatGPT mit der Begründung, dass es nicht sachkundig genug sei und die Menschen in die Irre führe. Es wurde auch betont, dass kleine Kinder nicht vor den Auswirkungen von ChatGPT geschützt seien.

KANADA UND ÖSTERREICH KLAGEN GEGEN KI

Während die Entscheidungen gegen das von OpenAI entwickelte ChatGPT nacheinander fielen, gab Kanada bekannt, dass es eine Untersuchung gegen das in den USA ansässige Softwareunternehmen OpenAI, den Hersteller von ChatGPT, eingeleitet hat. Der kanadische Implementierungskommissar Philippe Dufresne erklärte, dass die Untersuchung von OpenAI „eine Beschwerde wegen angeblicher unbefugter Erfassung, Verwendung und Offenlegung personenbezogener Daten“sagen, dass es angefangen hat „Wir müssen mit der rasant fortschreitenden technologischen Entwicklung Schritt halten und immer einen Schritt voraus sein, und das ist einer meiner Schwerpunkte“genannt.

In Australien, Hepburn Town Leader Brian Hood, „Dem Bestechungsvorwurf ausgesetzt“ reichte eine Klage gegen ChatGPT ein, die seinen Anspruch teilte. Die Anwälte schickten am 21. März einen Brief an OpenAI, den Eigentümer von ChatGPT, und forderten OpenAI auf, das Unrecht an ihren Mandanten zu korrigieren. Anwälte sagten, OpenAI habe jetzt nicht auf Hoods Rechtsschreiben geantwortet.

In Deutschland schließlich erklärte Kelber, der für den Schutz personenbezogener Daten und die Informationsfreiheit der Bundesregierung zuständig ist, dass sie ChatGPT, einen auf künstlicher Intelligenz basierenden Chat-Roboter, bei Bedarf grundsätzlich aufgrund von Informationen blockieren können Sicherheitsbedenken.

BILL GATES UND ELON MUSK WIEDER

Obwohl Microsoft-Gründer Bill Gates, der mehr als 10 Milliarden Dollar in OpenAI investiert hat, ChatGPT verwendet. trafen sich seit 1980 wertvollste Technologie obwohl er es beschreibt als; Elon Musk, Besitzer von SpaceX, Tesla und Twitter, „begrenztes Verständnis“er denkt er hat.

Auf die Frage, ob künstliche Intelligenz gefährlich sei oder nicht, antwortete US-Führer Biden wie folgt: „Die Zeit wird es vielleicht zeigen. Ich denke, Technologieunternehmen haben die Verantwortung, sicherzustellen, dass sie Vertrauen haben, bevor sie ihre Arbeit der Öffentlichkeit zugänglich machen …

ARBEITSPLÄTZE VON 300 MILLIONEN MENSCHEN IN GEFAHR

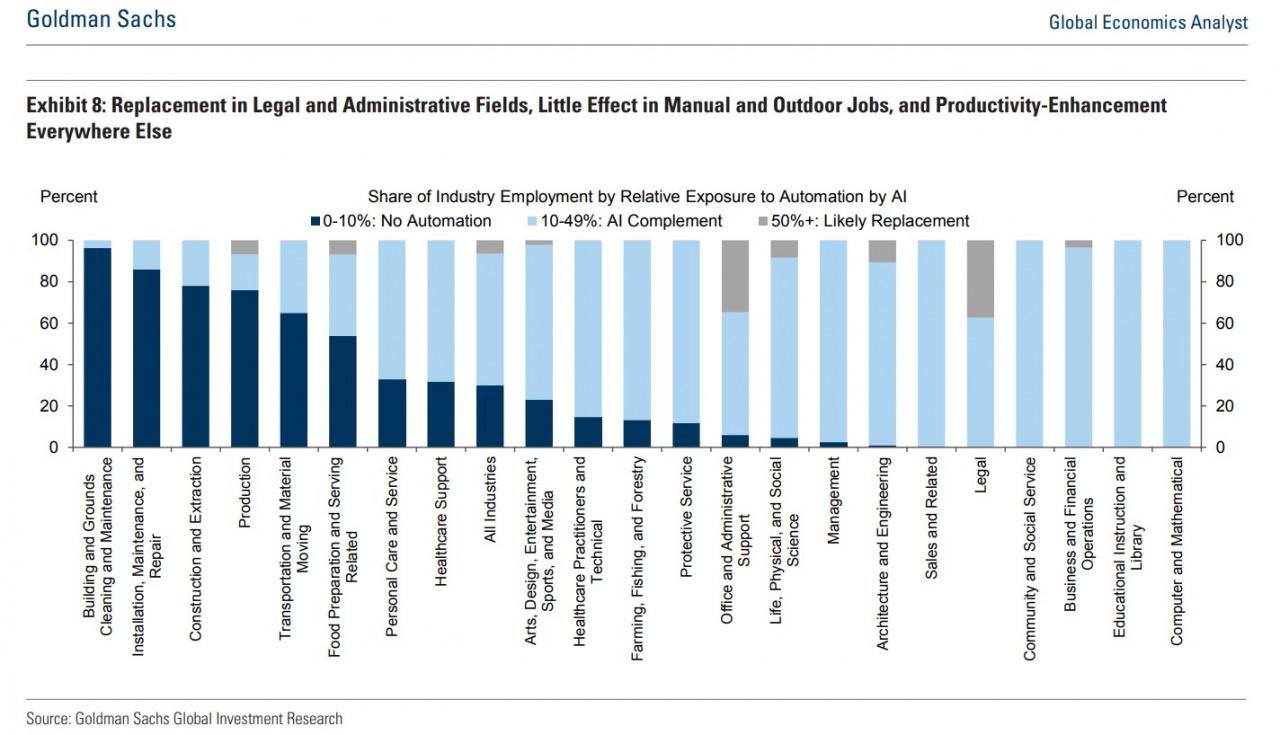

Anwendungen der künstlichen Intelligenz für jetzt ‚um Ihre Arbeit zu erleichtern‘ Obwohl es mit dem Slogan serviert wird, können diese Anwendungen laut Experten einige Geschäftszweige gefährden, wenn sie sich weiterentwickeln. Goldman Sachs, eine der größten Investmentbanken der Welt, erklärte in ihrem Bericht, dass die Entwicklung von Technologien für künstliche Intelligenz in den kommenden Jahren Hunderte Millionen Menschen arbeitslos machen könnte. . Nach Angaben der Bank umfasst diese Zahl mehr als 300 Millionen Menschen.

Die am stärksten betroffenen Berufsgruppen sind:

46 % in Büro- und Verwaltungsdienstleistungen

44% im Bereich Recht

37 % in Architektur und Ingenieurwesen

36 % in Physik und Sozialwissenschaften

35% im Bereich Wirtschaft

Sprich mit Haber7 über das Thema Professor Dr. Cem Sefa Sütçü von der Verbindungsfakultät der Marmara-UniversitätEr wies darauf hin, dass es nicht ausreichen würde, das Problem nur durch persönliches Wissen zu betrachten, und betonte, dass die Praktiken in verantwortungsvoller Weise gegenüber der Menschheit fortgesetzt werden sollten.

Hier sind die Aussagen von Sütçü;

Auf der Seite der künstlichen Intelligenz gibt es eine sehr rasante Entwicklung. Gleichzeitig ergeben sich einige Fragen und Probleme. Aber es gibt auch eine Situation wie diese; So musste es sein…

„‚VERANTWORTUNG‘ STATT VERBOT“

Einerseits wollen die Menschen Anwendungen künstlicher Intelligenz entwickeln, andererseits haben sie Angst davor. Natürlich wird ein Verbot niemals eine Analyse sein. Einmal gesperrt, bleiben diese weiterhin verborgen. Daher wäre es angemessener zu sagen, es nicht zu tun, sondern es statt einer Analyse zu organisieren.

Um dies zu entwickeln, wurden seit jeher verschiedene Werkzeuge verwendet, da die menschlichen Fähigkeiten begrenzt sind. Maschinen, Computer und jetzt künstliche Intelligenz … Hier muss der gesunde Menschenverstand ins Spiel kommen. Kontroll-, Regel- oder Selbststeuerungsprozesse müssen funktionieren.

„SIE WISSEN NICHT ALLES UND SPRECHEN NICHT IMMER DIE WAHRHEIT“

Es gibt auch das Ende von Anwendungen für künstliche Intelligenz wie ChatGPT oder ähnliches. Da diese Anwendungen nicht alles wissen, können sie nicht immer die Wahrheit sagen. Wir lehren diese Praxis als Kind. So funktioniert maschinelles Lernen. Wenn wir Kindern Gutes beibringen, werden sie Gutes tun, und wenn wir Schlechtes lehren, werden sie Schlechtes tun.

WOHER BEKOMMT KÜNSTLICHE INTELLIGENZ INFORMATIONEN?

Diese Anwendungen nutzen öffentlich verfügbare Informationen im Internet. Zum Beispiel macht Google dasselbe. Bei den Informationen, die Google uns zeigt, handelt es sich nicht um sie, sondern um öffentlich im Internet veröffentlichte Daten… ChatGPT hingegen präsentiert diese Suche und Informationen in Form eines auf künstlicher Intelligenz basierenden Dialogs.

WIR BEGONNEN DEN KONTAKT MIT MASCHINEN, INDEM WIR DEN DIALOG SCHAFFEN

Da kommt mir die Frage in den Sinn? Warum werden andere Apps nicht gesperrt? Hier gibt es einen Unterschied; ChatGPT ist eine künstliche Intelligenz. Im Gegensatz zu den alten Anwendungen kann ChatGPT lernen, indem es diese Informationen nimmt, und es antwortet uns mit einer Fiktion, die auf dem, was es gelernt hat, basiert. Mit der Entwicklung der künstlichen Intelligenz wird sich die Fiktion, die sie uns bietet, weiterentwickeln. ChatGPT verfügt über Sprachkenntnisse. Es war etwas, was die Leute immer wollten. Wir Menschen kommunizieren im Dialog. Das bedeutet, dass wir uns irgendwann im Dialog mit den Maschinen verbinden. Stellen Sie sich vor, die ChatGPT-Anwendung konnte in 5 Tagen 1 Million Benutzer erreichen. Der Grund für diese große Nachfrage und dieses Interesse ist, dass die Menschen es aufgrund der Fähigkeit, Dialog- und Sprachkenntnisse aufzubauen, näher bei sich finden.

„WELT IST NICHT BEREIT, ABER…“

Es ist eine Tatsache, dass die Welt für diese Entwicklung noch nicht bereit ist, aber diese Studien müssen in einer „verantwortungsvollen“ Form fortgesetzt werden.

Durch die Veröffentlichung eines offenen Briefes wurde eine Petition gestartet, um Anwendungen künstlicher Intelligenz wie ChatGPT und andere zu stoppen. Mehr als 50.000 Unterschriften wurden gesammelt, hauptsächlich von SpaceX-, Tesla- und Twitter-CEO Elon Musk, Apples Mitbegründer Steve Wozniak und Autor Yuval Noah Harari.

Die Unterzeichner sagen kurz Folgendes: „ Diese Art von hochentwickelten künstlichen Intelligenzsystemen sollte entwickelt werden, wenn sichergestellt ist, dass sie kein Problem für den Menschen darstellen. Man kann diese Systeme sogar benutzen, um sich gegenseitig Schaden zuzufügen …“

„EINFLUSS AUF MENSCHEN UND WIRTSCHAFTEN IST JETZT UNBEKANNT“

Dem stimme ich auch zu. Die Nutzung begann mit der ersten Aufregung, etwas Neues zu finden, aber mit dieser Aufregung können einige Dinge kaputt gehen und verschüttet werden. Ich denke, die Bedeutung dieses offenen Briefes ist es, das Zerbrochene und Verschüttete einzusammeln … Anstatt zu verbieten, sollte diese Art von Dingen getan werden. Egal wer sie verbietet, sie werden in irgendeiner Form produziert, aber das Kostbare ist, dass sie weiterhin der Menschheit gegenüber verantwortlich sind. Momentan herrscht Unsicherheit. Welche Auswirkungen dies auf Menschen, Wirtschaft und Produktion haben wird, ist derzeit noch nicht bekannt. Sie brauchen Regulierung, kein Verbot. Dafür sind Recht, Ethik und Moral da. An diesen gilt es zu arbeiten. Andernfalls handelt es sich um ein Werkzeug, bei dem nicht klar ist, in wessen Händen es verwendet wird. Das bringt der Menschheit mehr Schaden als Nutzen.

Nachrichten7